Résumé – Face aux risques financiers et réputationnels liés aux interruptions, la résilience cloud s’appuie sur une architecture multi-AZ et multi-région, un réseau segmenté et des bases managées redondantes, complétée par des SLA/SLO/SLI avec budgets d’erreur et objectifs RTO/RPO. L’IaC, les tests de reprise et le chaos engineering, appuyés par un monitoring centralisé, valident la robustesse opérationnelle. Solution : déployer une infrastructure modulaire multi-zone alignée aux contraintes suisses, piloter le risque avec l’error budget et automatiser les processus pour garantir une disponibilité optimale.

Dans un contexte où l’indisponibilité peut entraîner des pertes financières et une atteinte à l’image, la haute disponibilité dans le cloud public exige une démarche proactive. Elle ne se limite pas à choisir un fournisseur mais implique une architecture multi-zones et multi-régions pensée, des réseaux segmentés, des bases de données redondantes et des scénarios de reprise testés.

Décortiquer les SLA, définir des SLO/SLI et maîtriser les budgets d’erreur permet de piloter le risque. L’automatisation via IaC, les tests réguliers et le chaos engineering renforcent la résilience. Enfin, l’arbitrage coûts vs sur-provisionnement et la prise en compte des contraintes suisses assurent une solution à la fois robuste et conforme.

Concevoir une architecture multi-AZ et multi-région

Une infrastructure haute disponibilité se construit sur un modèle multi-AZ puis multi-région. Les bonnes pratiques réseau et le choix des services managés renforcent la résilience.

Modèle multi-AZ actif-passif vs actif-actif

Le déploiement sur plusieurs zones de disponibilité (AZ) permet d’isoler les pannes localisées. En mode actif-passif, un seul site traite le trafic principal tandis que l’autre reste en veille, prêt à prendre le relais.

En mode actif-actif, chaque AZ supporte une part de charge, offrant une tolérance aux pannes plus fluide et un basculement sans interruption notable. Cette configuration exige une synchronisation continue et un équilibrage des sessions.

Exemple : Une entreprise du secteur financier a mis en place un cluster actif-actif sur deux régions Azure. Ce dispositif a démontré sa robustesse lors d’une panne AZ critique, garantissant la continuité des transactions et réduisant le RTO à quelques secondes.

Réseaux : sous-réseaux front-end et back-end

La segmentation des réseaux en sous-réseaux front-end et back-end renforce la sécurité et la fiabilité. Le front-end héberge les points d’entrée publics, tandis que le back-end regroupe les services métier et les bases de données.

Chaque sous-réseau peut être répliqué sur plusieurs AZ, assurant que la perte d’un segment n’impacte pas l’ensemble de la plateforme. Les ACLs et groupes de sécurité segmentent davantage le trafic.

Load balancers et bases managées zone-redondantes

Les load balancers, natifs du cloud, distribuent la charge entre plusieurs instances et zones. Ils surveillent en permanence la santé des services et redirigent automatiquement le trafic en cas de défaillance.

Les bases de données managées en zones redondantes (Azure SQL, AWS RDS Multi-AZ, Cloud SQL en GCP) garantissent une réplication synchrone ou asynchrone. Elles assurent la cohérence des données et une bascule transparente.

Assurer la fiabilité par les SLA, SLO, SLI et RTO/RPO

Les SLA définissent un engagement contractuel mais seuls les SLO/SLI et budgets d’erreur pilotent le risque en continu. Les objectifs RTO et RPO structurent les scénarios de reprise.

Décodage des SLA et service credits

Les SLA (Service Level Agreement) affichent des taux de disponibilité (par exemple 99,99 %) et prévoient des crédits si l’engagement n’est pas respecté. Toutefois, ces crédits ne compensent pas les impacts métier réels d’une panne.

Un taux de 99,99 % autorise environ 52 minutes d’indisponibilité par an. Comprendre la granularité des pannes (durée, fréquence) et les conditions d’éligibilité aux crédits évite les mauvaises surprises.

SLO, SLI et error budget pour piloter le risque

Les SLO (Service Level Objectives) fixent des seuils opérationnels à respecter périodiquement, tandis que les SLI mesurent la qualité de service (latence, taux d’erreur).

Le concept d’error budget (tolérance d’erreur) définit la marge d’incidents admissible. Chaque panne consomme ce budget, guidant les priorités entre innovation et stabilité.

Exemple : Une PME de e-commerce a mis en place des SLO de latence de 200 ms sur ses API. En surveillant l’error budget, elle a détecté une dérive progressive due à une mise à jour logicielle et a déclenché un rollback avant impact client, évitant une dégradation majeure.

RTO, RPO et priorisation du risque

Le RTO (Recovery Time Objective) définit la durée maximale d’interruption acceptable, le RPO (Recovery Point Objective) la quantité de données perdue tolérable. Ils guident la conception des stratégies de reprise.

Selon l’importance des workflows, les organisations classent leurs applications critiques et adaptent les modalités de sauvegarde, réplication synchrone ou asynchrone, et bascule automatique ou manuel.

Exemple : Un fournisseur de services de santé a aligné des RTO de 30 minutes et des RPO de 5 minutes sur ses bases patient. En combinant snapshots fréquents et réplication asynchrone, ce dispositif a assuré la continuité des dossiers sans perte notable en cas de bascule régionale.

Edana : partenaire digital stratégique en Suisse

Nous accompagnons les entreprises et les organisations dans leur transformation digitale

Automatisation, tests et chaos engineering

L’Infrastructure as Code et les tests de reprise garantissent une mise à l’échelle fiable. Les game days et le monitoring renforcent la résilience opérationnelle.

Infrastructure as Code avec Terraform

L’IaC permet de versionner et répéter les déploiements de façon fiable. Terraform, en multi-provider, facilite la cohérence entre Azure, AWS, GCP ou Infomaniak.

Les modules réutilisables standardisent les configurations réseau, compute et stockage. Les pipelines CI/CD déclenchent les mises à jour validées par des revues de code.

Tests de reprise et game days / chaos engineering

Les tests de reprise simulent des pannes planifiées (coupure d’AZ, arrêt d’instances) pour valider les runbooks. Ils assurent que les équipes maîtrisent les procédures avant crise.

Les game days, inspirés du chaos engineering, introduisent de l’aléa en production ou staging (déconnexion réseau, surcharge CPU). Ils révèlent les points faibles et améliorent la robustesse.

Monitoring et alerting

Un dispositif de monitoring centralisé (Prometheus, CloudWatch, Azure Monitor) collecte métriques et logs. Les dashboards offrent une vue unifiée de la santé des services.

Les alertes configurées sur les SLI critiques déclenchent des notifications automatiques (Slack, e-mail) et des playbooks d’escalade. Les incidents sont documentés pour analyse post-mortem.

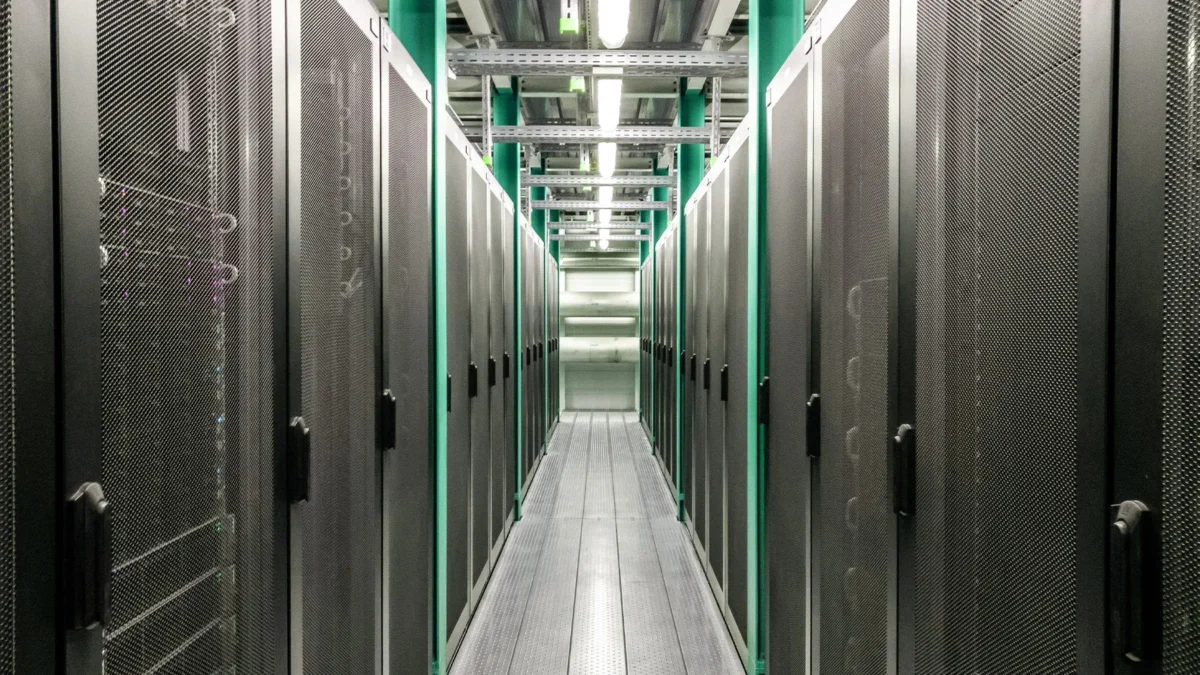

Coûts, arbitrages et spécificités suisses

L’évaluation du coût d’une panne vs le sur-provisionnement permet d’optimiser les budgets cloud. Les contraintes de latence, de résidence et de souveraineté en Suisse influencent les choix de régions.

Analyser le coût d’une panne vs sur-provisionnement

Le coût d’une panne englobe pertes de chiffre d’affaires, pénalités contractuelles et atteinte à la réputation. Il peut dépasser largement le surcoût d’une redondance accrue.

Un calcul de retour sur investissement compare le coût horaire d’une indisponibilité (RTO) aux dépenses liées à la réplication multi-région ou au scaling automatique.

Exemple : Une entreprise manufacturière a chiffré à 20 000 CHF par heure une interruption de ses lignes de production. Le choix d’un cluster multi-AZ a représenté 15 000 CHF/an, jugé plus économique que tout arrêt imprévu.

Spécificités suisses : latence, résidence et conformité

La localisation des données en Suisse ou dans l’UE répond aux exigences de souveraineté et de conformité (RGPD, FINMA). Elle limite la latence pour les utilisateurs locaux.

Le choix d’Infomaniak ou de régions Azure/Google en Suisse évite le transit vers l’étranger et simplifie les audits, tout en offrant des engagements de disponibilité comparables aux grands hyperscalers.

Garantissez une disponibilité optimale de vos services cloud

La conception d’une architecture multi-AZ et multi-région, associée à une segmentation réseau et à des bases managées redondantes, fonde la résilience. La distinction entre SLA et SLO, appuyée par l’error budget, permet de piloter le risque de manière proactive. Les RTO et RPO structurent les choix de reprise, tandis que l’automatisation, les tests et le chaos engineering valident les processus. Enfin, l’arbitrage coûts vs résilience et la prise en compte des contraintes suisses garantissent une solution à la fois robuste et conforme.

Pour transformer ces bonnes pratiques en un plan d’action concret adapté à votre contexte, nos experts sont à votre disposition. Ils vous accompagneront dans l’élaboration d’une architecture évolutive, sécurisée et alignée avec vos enjeux métiers et réglementaires.

Lectures: 157

Lectures: 157