Résumé – Pour garantir performance et agilité, l’IA embarquée supprime les allers-retours réseau, accélère le traitement en temps réel, optimise la bande passante et renforce la sécurité des données. Cet article détaille les bénéfices et les contraintes clés liés aux capacités des microcontrôleurs, à la consommation énergétique et à la gouvernance des modèles, puis décrit les phases de collecte de données, d’entraînement et de quantification, de packaging sur microcontrôleurs, de validation et d’optimisation continue via MLOps.

Solution : adopter une architecture modulaire open source pilotée par un pipeline MLOps encadré par des experts pour un déploiement fiable, évolutif et ROI-driven.

L’émergence de l’intelligence artificielle sur les appareils embarqués transforme la manière dont les systèmes opèrent en contexte contraint. Les entreprises suisses disposant d’équipements distribués peuvent désormais traiter les données au plus proche de la source, réduisant la dépendance au réseau et les temps d’attente.

À l’heure où l’edge computing gagne du terrain, comprendre les bénéfices, les limites et les étapes d’implémentation de l’IA embarquée est essentiel pour assurer la compétitivité et la réactivité des projets. Ce guide pratique s’adresse aux décideurs IT et aux équipes techniques souhaitant intégrer efficacement des modèles de machine learning dans leurs microcontrôleurs et systèmes embarqués.

Bénéfices concrets de l’IA embarquée

L’intégration de l’IA directement sur le périphérique permet des traitements ultra-rapides et autonomes. Cette approche réduit la latence, économise la bande passante et renforce la sécurité des données sensibles.

Réduction de la latence et traitement en temps réel

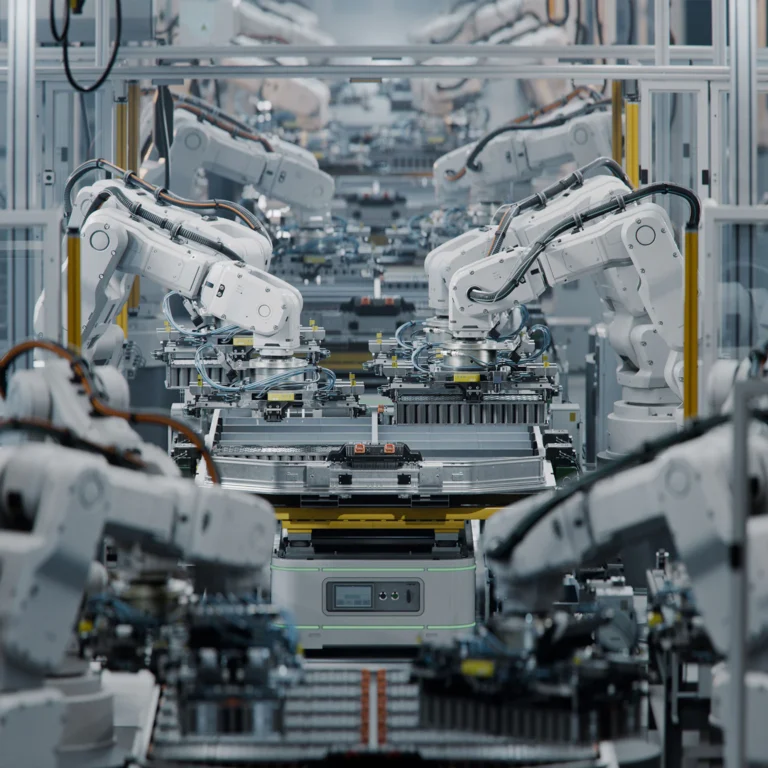

Traiter les données sur l’appareil élimine les allers-retours vers le cloud, offrant des réponses immédiates. Cette rapidité est cruciale pour des applications critiques, comme la détection de défauts en production ou le filtrage de signaux audio pour la reconnaissance vocale. En supprimant la dépendance réseau, la qualité de service reste constante, même dans les environnements isolés ou à faible couverture.

Les systèmes embarqués bénéficient de cette proximité de calcul pour fonctionner de manière autonome, par exemple dans les équipements industriels ou les drones. Les architectures basées sur des microcontrôleurs dotés d’unités d’accélération dédiées (ASIC, TPU) tirent pleinement parti de l’IA embarquée. L’efficience du traitement local se traduit par une amélioration de la réactivité et une réduction des coûts opérationnels.

En environnement médical, des capteurs intelligents peuvent analyser en temps réel des signes vitaux et alerter instantanément le personnel. Cette capacité accélère les diagnostics et garantit un suivi continu sans surcharge des réseaux hospitaliers. L’edge AI devient ainsi un atout pour les processus critiques où chaque milliseconde compte.

Optimisation de la consommation de bande passante

L’envoi massif de données brutes vers des serveurs cloud peut rapidement saturer les canaux de communication. En extrayant sur l’appareil uniquement les informations pertinentes (anomalies, événements clés), l’IA embarquée réduit significativement le trafic réseau. Cette compression intelligente prévient les goulets d’étranglement et garantit une meilleure disponibilité des liaisons.

Les entreprises opérant sur des sites isolés, comme des stations de mesure en montagne ou des plates-formes pétrolières, profitent ainsi d’un flux de données optimisé. Les coûts de transfert sont maîtrisés, et la continuité de service est assurée même lors de perturbations réseau. Cette approche modulaire facilite également l’intégration de solutions hybrides, combinant edge et cloud hybride.

Le tri local des données multimédias (images, vidéos) avant envoi permet de réduire jusqu’à 80 % du volume transmis. Les traitements de pré-filtrage et de détection embarqués alimentent uniquement le back-end en informations utiles, évitant les pics de trafic et augmentant la fiabilité des transmissions. Cette stratégie s’inscrit dans une démarche ROI-driven et durable.

Renforcement de la sécurité et de la fiabilité

Garder les données sensibles à la source limite les risques liés aux interceptions ou aux attaques en transit. Les microcontrôleurs peuvent exécuter des modèles de chiffrement et de détection d’intrusions directement sur l’appareil, renforçant ainsi la résilience du système. Cette sécurité by design répond aux exigences réglementaires strictes, notamment dans les secteurs médical et financier.

Une entreprise spécialisée dans la télémétrie a déployé un système embarqué capable d’analyser localement les vibrations de machines-outils. Cette solution a démontré une réduction de 90 % des incidents liés à des malfaçons, tout en assurant la confidentialité des données industrielles. L’exemple illustre la valeur ajoutée de l’IA en périphérie pour la maintenance prédictive et la sécurisation des processus critiques.

En cas de coupure réseau, les dispositifs continuent de fonctionner de façon autonome, assurant une collecte et une analyse continues. La redondance locale des modèles évite toute interruption de service et garantit une disponibilité maximale. Cette robustesse est un atout majeur pour les déploiements dans des contextes exigeants.

Limitations de l’IA en périphérie

Les ressources matérielles limitées des systèmes embarqués imposent des compromis sur la taille et la complexité des modèles. Les enjeux de mise à jour, d’alimentation énergétique et de dissipation thermique doivent être pris en compte dès la conception.

Contraintes liées aux ressources matérielles

Les microcontrôleurs et processeurs embarqués disposent souvent de mémoire vive et de capacités de calcul limitées. Il n’est pas possible d’y déployer des réseaux de neurones volumineux ou des architectures massives sans adaptations. Les équipes doivent sélectionner avec soin les modèles et recourir à des techniques de quantification ou de pruning pour en réduire l’empreinte.

L’allocation de mémoire pour les buffers d’entrée et de sortie reste critique : un modèle trop volumineux peut saturer la RAM et provoquer des dysfonctionnements. Pour chaque projet, il convient de réaliser des benchmarks sur le matériel cible afin d’ajuster l’architecture du modèle. Cette étape garantit la robustesse du système dans des conditions réelles d’usage.

Les performances en inference peuvent varier significativement selon le type de processeur et la présence d’accélérateurs dédiés. Certains microcontrôleurs intègrent des blocs DSP ou des co-processeurs IA, mais cela augmente le coût matériel. Il faut donc arbitrer entre performance, budget et pérennité du dispositif.

Défis de centralisation et mise à jour des modèles

Pour garantir la qualité des prédictions, les modèles requièrent périodiquement un réentraînement avec de nouvelles données. Centraliser ces informations peut poser des problèmes de latence et de conformité, surtout en présence de données sensibles. Les stratégies de fédération ou de transfert d’apprentissage partiel sont souvent nécessaires pour limiter ces contraintes.

Une entreprise intervenant dans l’industrie manufacturière a dû faire face à la difficulté de réentraîner un modèle sur des capteurs de terrain dispersés. L’exemple montre l’importance d’un pipeline flexible capable de collecter des résultats et de les agréger sans compromettre la performance du dispositif. Cette approche a permis de limiter la charge réseau tout en maintenant un niveau d’accuracy élevé.

La gouvernance des versions de modèles devient rapidement complexe si plusieurs sites sont déployés. Des outils de gestion des artefacts et des stratégies de roll-back automatisées s’imposent pour éviter des incohérences entre les différents nœuds. La maintenance évolutive exige une architecture logicielle modulable.

Consommation énergétique et gestion de la chaleur

Le calcul intensif requis par l’inférence IA augmente la consommation électrique, impactant l’autonomie des appareils fonctionnant sur batterie. Les choix de fréquence d’horloge et de modes d’économie d’énergie doivent être optimisés pour préserver l’endurance du dispositif. Une analyse fine de la balance performance/consommation s’avère indispensable lors du design.

La dissipation thermique peut dépasser les capacités de refroidissement passif, entraînant une dégradation prématurée des composants. Des simulations thermiques et des tests en conditions extrêmes sont recommandés pour anticiper les risques. Les solutions de gestion dynamique de la fréquence et des voltage rails aident à maîtriser ces effets sans compromettre la fiabilité.

Dans certains cas, l’intégration d’algorithmes de scheduling permet de répartir la charge de calcul sur des périodes moins critiques, limitant ainsi les pics de consommation. Cette orchestration logicielle combine exigences métier et contraintes hardware pour garantir une disponibilité durable du système.

Edana : partenaire digital stratégique en Suisse

Nous accompagnons les entreprises et les organisations dans leur transformation digitale

Phases d’intégration de l’IA dans un système embarqué

Le déploiement d’une solution IA embarquée suit un cheminement précis : de la collecte des données à la mise en service sur le microcontrôleur. Chaque étape requiert des outils et des pratiques adaptés pour assurer la performance et la maintenabilité.

Collecte et préparation des données

La qualité d’un modèle IA dépend en premier lieu de la pertinence et de la diversité des données d’entraînement. Pour un projet de reconnaissance vocale embarquée, il est nécessaire de collecter des enregistrements issus de scénarios réels : environnements bruyants, accents variés et différents niveaux de volume. Cette phase requiert des scripts d’ingestion et des pipelines de nettoyage pour garantir l’uniformité du format.

Les données doivent ensuite être étiquetées avec précision : transcription de la parole, marquage des phonèmes ou classification des mots-clés. Cette annotation peut être automatisée partiellement, mais une révision humaine reste souvent indispensable pour corriger les erreurs. Les équipes d’ingénierie et de linguistes collaborent pour créer un dataset fiable et riche.

Enfin, le jeu de données est segmenté en ensembles d’entraînement, de validation et de test. Cette répartition assure une évaluation objective de la performance du modèle et évite le sur-apprentissage. Des techniques de data augmentation (ajout de bruit, décalages temporels) contribuent à améliorer la robustesse dans des conditions variées.

Entraînement, compression et validation du modèle

L’entraînement initial s’effectue généralement sur des GPU dans le cloud ou sur des serveurs dédiés. Les frameworks open source comme TensorFlow ou PyTorch offrent une flexibilité optimale pour expérimenter différentes architectures de réseaux de neurones. Les hyperparamètres (taux d’apprentissage, nombre de couches, fonctions d’activation) sont ajustés via des processus de cross-validation.

Une fois le modèle entraîné, il faut le compresser pour qu’il tienne sur le périphérique cible. TensorFlow Lite permet de convertir et de quantifier le modèle, réduisant sa taille et sa consommation mémoire. L’outil LiteRT optimise ensuite les kernels pour accélérer l’inférence sur des microcontrôleurs à ressources limitées.

Un exemple d’intégration dans un appareil industriel a démontré que le modèle de reconnaissance vocale initial de 200 Mo a été réduit à 3 Mo grâce à la quantification 8 bits, tout en conservant 95 % d’exactitude. Cet exemple montre qu’une optimisation rigoureuse rend possible l’exécution sur un microcontrôleur sans compromettre la qualité de service.

Les phases de test incluent des benchmarks sur des jeux de données en conditions réelles et des mesures de latence et de consommation énergétique. Ces validations préservent la fiabilité une fois le modèle déployé sur le matériel définitif.

Déploiement sur microcontrôleurs

Le packaging du modèle dans une application embarquée nécessite l’intégration d’un runtime adapté, comme TensorFlow Lite Micro ou un moteur d’inférence propriétaire open source. Le code doit être compilé pour l’architecture cible (ARM Cortex-M, RISC-V, etc.) en respectant les contraintes de mémoire flash et de RAM.

Les développeurs construisent des modules logiciels modulaires : un gestionnaire de flux audio, un pipeline de preprocessing et un wrapper d’inférence. Cette séparation facilite la maintenance et les évolutions futures. Les frameworks CI/CD automatisent la compilation croisée et les tests unitaires pour chaque nouvelle version.

Des tests d’intégration finaux sont réalisés sur des bancs de test physiques, simulant les conditions d’utilisation (température, vibrations, interférences radio). Ces essais permettent de vérifier la robustesse du firmware et la stabilité des résultats. Tout écart détecté déclenche une remontée d’incident et un travail itératif pour corriger le tir.

Assurance qualité et optimisation continue

Une fois déployée, l’IA embarquée doit faire l’objet de tests réguliers et d’une collecte de feedback pour ajuster les modèles. La maintenance évolutive et le retraining itératif garantissent la pérennité et la performance de la solution.

Tests post-déploiement fonctionnels et de performance

Après l’installation sur le parc de dispositifs, des tests fonctionnels vérifient la cohérence des résultats avec les exigences métiers. Des scripts automatisés génèrent des scénarios réalistes, mesurent la latence et comparent les prédictions à des jeux de référence. Toute dérive statistique doit déclencher une alerte.

Les métriques clés incluent le taux de reconnaissance, le temps de réponse moyen et l’usage CPU/RAM. Ces indicateurs sont collectés via des journaux embarqués et remontés périodiquement vers le back-end. Les dashboards de suivi aident à anticiper les besoins de mise à jour et à prendre des décisions informées pour l’urbanisation future du système.

En outre, des tests d’endurance simulent un fonctionnement continu sur plusieurs jours. Ces essais valident la stabilité thermique et la constance des performances. Les anomalies détectées servent à améliorer le firmware et à ajuster les paramètres d’exécution.

Collecte de données d’expérience utilisateur

L’interaction avec les utilisateurs ou les techniciens de maintenance génère des retours précieux pour affiner les modèles. Des journaux enregistrent les cas d’erreur, les confusions de reconnaissance et les contextes d’utilisation. Cette collecte s’effectue dans le respect des normes RGPD et des politiques internes de confidentialité.

Les feedbacks utilisateur sont examinés par une équipe pluridisciplinaire (data scientists, UX, ingénieurs) pour identifier les axes d’amélioration prioritaires. Cette gouvernance agile assure une évolution continue sans perturber le service en production.

Affinement et mises à jour itératives

Lorsque les données terrain révèlent de nouvelles contraintes, le modèle est mis à jour via un processus de retraining. Les jeux de données existants sont complétés par les nouveaux exemples avant de relancer l’entraînement en batch. Les pipelines de MLOps automatisés facilitent cette opération, de la génération du modèle jusqu’au packaging.

Les procédures de déploiement progressif (canary releases) permettent de diffuser la mise à jour sur une fraction des appareils avant un rollout complet. Cette méthode limite les risques et garantit un retour arrière rapide en cas de régression. Les indicateurs de performance guident la décision de généraliser la nouvelle version.

La documentation technique et les changelogs sont tenus à jour pour chaque version de modèle, assurant la traçabilité. Les équipes peuvent ainsi analyser l’historique des évolutions et anticiper les prochaines optimisations.

Faites de l’IA embarquée un levier d’innovation durable

Les bénéfices de l’IA embarquée sont avérés : réduction de la latence, optimisation du trafic réseau, renforcement de la sécurité et autonomie des dispositifs. Toutefois, les contraintes matérielles, énergétiques et de gouvernance des modèles nécessitent une planification rigoureuse. En suivant les étapes de collecte, d’entraînement, de déploiement, puis de tests et d’affinement, il est possible de délivrer des solutions fiables et évolutives.

Face à l’accélération des usages et la diversité des contextes d’application, adopter une approche modulaire, open source et orientée retour sur investissement garantit la pérennité des systèmes. Notre équipe d’experts accompagne chaque phase pour adapter les technologies aux spécificités métiers et techniques de chaque projet.

Lectures: 49

Lectures: 49