Résumé – Quand l’enjeu est une recherche documentaire précise vs actions métiers automatisées, le choix du framework détermine la réussite : LlamaIndex pour ingérer, chunker, indexer et garantir la traçabilité en RAG, LangChain pour orchestrer chaînes de prompts, agents et intégrations externes. LlamaIndex offre connecteurs prêts à l’emploi, chunking sémantique, reranking et recherche hybride optimisant la pertinence et le coût en tokens, tandis que LangChain structure des workflows multi-étapes, gère mémoire conversationnelle, logs et callbacks pour un audit trail et un human-in-the-loop contrôlé. La solution consiste à combiner LlamaIndex en couche retrieval et LangChain (ou LangGraph) pour piloter dialogues et actions, intégrant sécurité, monitoring et gouvernance afin de passer rapidement du prototype à un système IA robuste et évolutif.

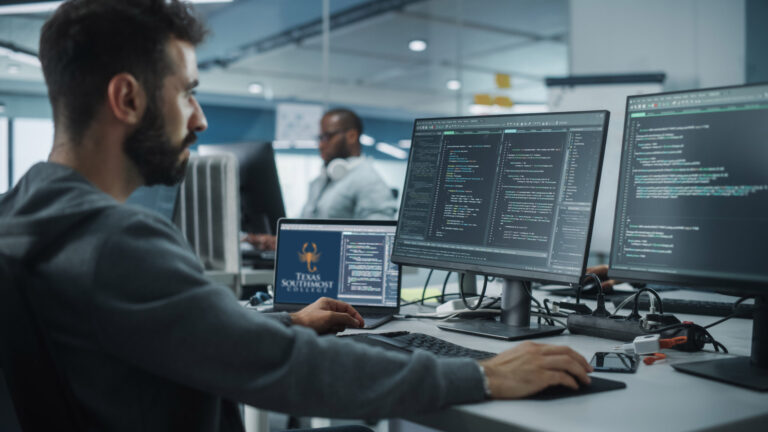

Lorsque les entreprises envisagent de déployer un chatbot documentaire, un assistant interne ou un moteur de recherche intelligent, le choix des briques IA conditionne la réussite du projet. Entre connecter efficacement un modèle de langage aux données et orchestrer des workflows multi-étapes, deux frameworks se distinguent : LlamaIndex et LangChain.

Pourquoi LlamaIndex excelle en RAG centrée données

LlamaIndex est conçu pour ingérer, découper et indexer des données hétérogènes afin de fournir un contexte précis aux modèles de langage. Il brille dans les architectures RAG où la qualité de récupération documentaire prime sur la complexité des workflows.

Spécialisation ingestion et indexation

LlamaIndex propose des connecteurs prêts à l’emploi pour PDF, bases de données, wikis et APIs internes. Son moteur de chunking segmente automatiquement les documents selon la sémantique et la taille optimale pour les embeddings.

Chaque chunk est encodé en vecteurs et stocké dans un vector store compatible avec des solutions open source ou des services cloud. Cette méthode garantit une couverture fine des sujets et réduit le risque de perdre des informations lors des requêtes.

La modularité du pipeline permet de personnaliser les parsers et d’ajouter des étapes de nettoyage ou d’enrichissement métier. On peut ainsi normaliser les données avant indexation pour renforcer la cohérence des réponses dans le cadre du cycle de vie des données.

Optimisation de la recherche documentaire

Le framework intègre des stratégies de reranking et de hybrid search pour combiner recherche vectorielle et filtrage lexical. Les résultats sont réordonnés selon la pertinence sémantique et la fraîcheur des documents.

En scenarii RAG, un query engine dédié orchestre la récupération et le passage de contexte au LLM. Il insère uniquement les passages les plus pertinents, limitant le coût en tokens et la latence.

Des mécanismes de multi-document reasoning aident à synthétiser des réponses issues de sources variées, tout en citant les extraits originaux. Cette traçabilité est cruciale dans les secteurs réglementés.

Cas d’usage finance

Une institution financière a centralisé plusieurs milliers de contrats et rapports de conformité. Elle souhaitait un assistant capable d’identifier les clauses précises selon des requêtes métier.

Grâce à LlamaIndex, chaque document a été découpé, indexé puis enrichi avec des métadonnées métiers. Les utilisateurs obtiennent désormais des extraits précis, citant page et paragraphe.

Ce projet a réduit de 70 % le temps de recherche documentaire lors des audits internes. Il a aussi permis de limiter les erreurs d’interprétation juridique grâce à la citation explicite des sources.

L’exemple montre que lorsque la donnée documentaire est complexe et volumineuse, LlamaIndex devient la brique de retrieval privilégiée pour garantir précision et traçabilité.

LangChain : orchestrer des workflows IA complexes

LangChain offre une plateforme pour enchaîner prompts, appeler des outils externes et gérer une mémoire conversationnelle. Il s’impose dès que l’application doit réaliser des actions, suivre des logiques conditionnelles ou interagir avec plusieurs systèmes.

Chaînes de traitement et gestion de prompts

LangChain structure les interactions avec le LLM sous forme de chains, combinant prompts dynamiques et templates. Chaque étape peut pré- ou post-traiter la réponse pour l’adapter aux besoins métiers.

Les prompts peuvent inclure des variables, des instructions de style et des exemples de façonnage, garantissant une qualité de réponse constante. Les templates sont versionnés pour faciliter le suivi des évolutions.

On peut aussi implémenter des logiques conditionnelles dans les chains, déclenchant des branches selon les réponses de l’IA. Cette flexibilité permet de créer des dialogues complexes sans sacrifier la maintenabilité.

Agents et intégration d’outils externes

LangChain introduit le concept d’agents capables de prendre des décisions : appeler des APIs, interroger un CRM, envoyer un email ou créer un ticket dans un système ITSM. Chaque outil est encapsulé dans un wrapper pour garantir une utilisation sécurisée.

Une mémoire conversationnelle peut être maintenue entre les invocations, stockant des états ou contextes métier. Cette mémoire est réutilisée pour personnaliser les interactions et éviter de répéter des informations.

Les agents peuvent être monitorés, stoppés ou relancés via des mécanismes de callback. Cette supervision est essentielle pour les workflows critiques où l’on exige un audit trail et une validation humaine en cas d’incertitude.

Cas d’usage e-commerce

Une plateforme e-commerce a développé un agent RevOps capable de qualifier automatiquement les leads. L’agent récupère les données CRM, évalue la priorité commerciale et crée des tâches dans l’outil de gestion des ventes.

En cas de doute, il génère une notification Slack pour demander l’intervention d’un responsable. Ce workflow multi-étapes fait appel à des scripts internes et à des APIs tierces, orchestrés par LangChain.

Le projet a augmenté la réactivité commerciale de 50 % et réduit les coûts opérationnels du funnel. Il illustre l’intérêt de LangChain quand l’enjeu est l’exécution d’actions complexes, non la simple recherche d’information.

Cette réalisation démontre que, pour des workflows métiers intégrés à plusieurs systèmes, LangChain constitue le framework de référence pour orchestrer et monitorer des agents IA.

Edana : partenaire digital stratégique en Suisse

Nous accompagnons les entreprises et les organisations dans leur transformation digitale

Architectures hybrides pour des applications IA robustes

Combiner LlamaIndex en couche de retrieval et LangChain pour gérer le dialogue et les actions offre le meilleur des deux mondes. Cette approche modulaire répond aux besoins de précision documentaire et de logique métier avancée.

Exemple d’architecture hybride

Le schéma combine un vector store alimenté par LlamaIndex pour extraire les passages pertinents, puis une chain LangChain pour contextualiser la réponse et déclencher les outils nécessaires. La couche RAG fournit un contexte fiable avant chaque action IA.

Après retrieval, le LLM produit une synthèse ou une recommandation, puis appelle un agent LangChain pour exécuter des opérations (création de ticket, mise à jour CRM). Les logs sont synchronisés avec un tableau de bord de monitoring.

Cette séparation claire entre data layer et orchestration layer facilite les évolutions futures. On peut par exemple remplacer le moteur vectoriel sans impacter les workflows définis dans LangChain.

L’approche hybride préserve l’indépendance des briques et limite le vendor lock-in : on reste libre d’opter pour du open source ou du cloud selon les exigences de sécurité et de coûts.

Workflow RAG avancé

Dans un scénario typique, LlamaIndex construit l’index, réalise le chunking et stocke les embeddings. Au runtime, LangChain interroge le vector store, récupère les passages et formate la requête augmentée pour le LLM.

Le LLM génère une réponse enrichie puis un agent LangChain décide si l’information doit être transmis directement à l’utilisateur ou s’il faut créer une action (ticket, email, alerte). Chaque étape est journalisée.

Des mécanismes de fallback interviennent si le retrieval échoue ou si le LLM renvoie une réponse incertaine. L’humain peut alors reprendre la main via un module human-in-the-loop intégré au workflow.

Cette orchestration fine garantit une expérience utilisateur fluide tout en maintenant un niveau de contrôle élevé sur la qualité et la sécurité des réponses.

Cas d’usage construction

Une entreprise de construction a mis en place un assistant IA pour traiter les demandes techniques sur les chantiers. L’outil cherche d’abord la procédure adéquate via LlamaIndex, puis LangChain génère un ticket dans l’outil de helpdesk.

Si la procédure est trop complexe, l’agent envoie une alerte à l’équipe terrain et propose simultanément une réponse automatisée aux utilisateurs, réduisant les temps d’attente.

La solution a permis de traiter plus de 80 % des tickets sans intervention humaine, tout en conservant un taux de satisfaction élevé grâce à la précision de la retrieval initiale.

Ce cas montre l’efficacité des architectures hybrides pour combiner précision documentaire et automatisation de workflows métier.

Passer en production : défis, LangGraph et bonnes pratiques

Mettre un prototype RAG ou un agent IA en production exige de maîtriser le chunking, la gestion des accès, la latence et la qualité des réponses. LangGraph apporte un formalisme de graphe d’état pour modéliser des workflows agents complexes et garantir leur résilience.

Sécurité, monitoring et gouvernance

En production, il faut chiffrer les données sensibles et mettre en œuvre une approche DevSecOps pour garantir des politiques d’accès granulaires. Les logs doivent tracer chaque appel au LLM et chaque action agentique pour répondre aux exigences d’audit.

Des pipelines de tests automatisés valident le chunking et le retrieval sur des jeux d’évaluation pour détecter les régressions documentaires. Les réponses du LLM sont soumises à un scoring de confiance.

Un système de monitoring en temps réel alerte en cas de montée anormale de latence ou d’erreurs d’API. La mise en place de tableaux de bord facilite la surveillance de la consommation de tokens et des coûts associés.

La gouvernance inclut des revues périodiques des prompts, des workflows LangChain et des graphes LangGraph pour garantir la conformité et la stabilité du système au fil des évolutions.

Gestion de la mémoire, fallback et human-in-the-loop

En production, la mémoire conversationnelle doit être stockée de manière sécurisée et réutilisable. Elle permet de conserver le contexte sur plusieurs sessions ou tickets.

Des mécanismes de fallback interceptent les cas où le LLM hallucine ou refuse de répondre. L’agent peut alors solliciter un opérateur humain pour valider la réponse ou corriger la trajectoire du workflow.

Le human-in-the-loop est prévu dans les graphes d’état : on peut définir des nœuds de validation où l’intervention d’un expert est requise avant de poursuivre. Cela limite les erreurs et renforce la confiance.

Cette orchestration contrôlée entre IA et humain garantit un équilibre entre automatisation et supervision, adapté aux secteurs réglementés.

LangGraph pour des agents métier contrôlés

LangGraph modélise un agent comme un graphe d’états, avec des transitions conditionnelles, des boucles et des points de sortie. Chaque nœud correspond à une action ou un appel LLM précis.

Ce formalisme facilite la compréhension, le test unitaire et la reprise d’exécution après incident. On peut simuler chaque chemin d’exécution avant déploiement.

LangGraph permet aussi d’intégrer des validations humaines ou des escalades automatiques en fonction des seuils de confiance calculés sur les réponses du LLM.

Pour des processus métier critiques, cette approche réduit la fragilité des agents IA et assure une traçabilité complète de chaque décision.

Construisez l’architecture IA adaptée à vos enjeux

Le bon choix n’est pas tant LangChain ou LlamaIndex isolément, mais l’architecture qui lie données, raisonnement, outils métier et contrôle humain. Selon que l’enjeu principal soit la gestion fine des documents ou l’orchestration d’actions, LlamaIndex, LangChain ou une combinaison hybride s’imposent.

Pour accélérer votre transition du prototype à un système IA robuste et évolutif, nos experts guident le cadrage du cas d’usage, la sélection des frameworks (incluant LangGraph), le design RAG, l’intégration API, la sécurité et la gouvernance, ainsi que le monitoring et la maintenance en continu.

Lectures: 61

Lectures: 61