Résumé – Sans architecture solide et process standardisés, un prototype lancé en mode « vibe coding » se transforme vite en usine à régressions, dette technique, surcoûts et incidents de production, freinant la vélocité et la montée en charge. Structurer les couches logicielles, automatiser tests et livraisons, versionner décisions et infrastructure, mettre en place monitoring et observabilité, modulariser API et pipelines de données, et synchroniser équipes autour d’indicateurs partagés.

Solution : adopter un refactoring incrémental, pipeline CI/CD robuste, Infrastructure as Code, registre de décisions et gouvernance claire pour garantir vitesse durable et scalabilité.

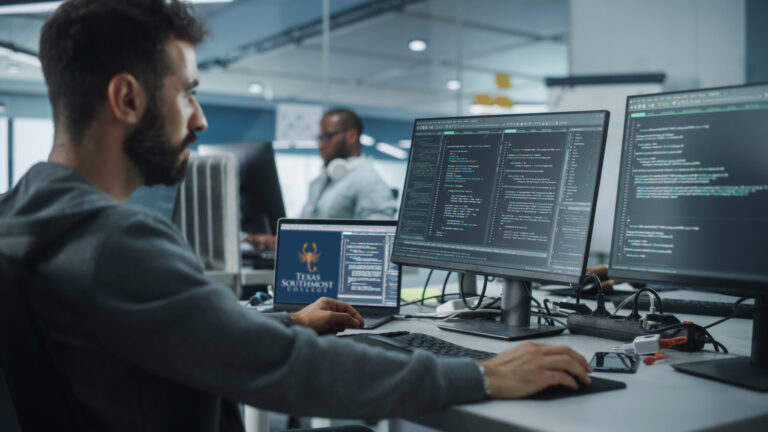

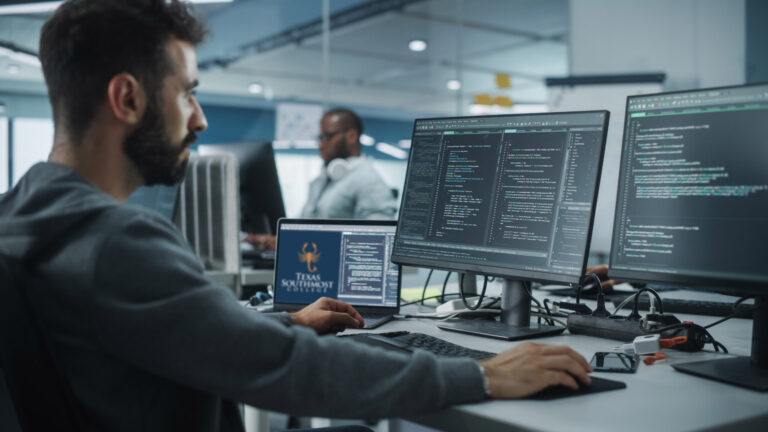

Dans un contexte où l’IA permet de lancer un prototype en quelques jours, la tentation du “vibe coding” — coder vite, tester peu, improviser sans cadre — est forte.

Pourtant, un MVP qui prend de l’ampleur sans une architecture solide se transforme rapidement en fardeau : régressions imprévisibles, complexité exponentielle, dette technique galopante. Pour passer d’un prototype inspiré à un produit scalable, il faut structurer dès le départ ses couches logicielles, automatiser ses tests, documenter ses choix et mettre en place des processus de livraison disciplinés. Voici quatre axes clés, illustrés par des cas suisses, pour éviter cinq erreurs coûteuses et garantir une vitesse durable.

Éviter l’impasse du “Vibe Mode”

Vous ne devez pas confondre vitesse et structure. Sans tests, séparation et documentation, le prototype vire au cauchemar. Une base mal pensée finit toujours par engendrer régressions, dette technique et surcoûts.

Manque de tests automatisés

Lorsque les premiers jalons d’un prototype sont posés sans tests unitaires ou d’intégration, chaque modification devient un pari. Les développeurs hésitent à toucher au code existant par crainte de casser une fonctionnalité. Le résultat est un ralentissement progressif de la vélocité, sans parler des pannes en production qui apparaissent à chaque itération.

Un workflow sans tests expose aussi à des régressions invisibles, qui ne sont détectées que lorsque l’usage réel se met en place. Les correctifs urgents se multiplient, les hotfixes s’empilent, et la dette technique devient ingérable.

La solution consiste à intégrer dès le premier sprint des suites de tests automatisés, couvrant les cas critiques de la logique métier. Un pipeline CI dédié permet de valider systématiquement chaque commit et d’alerter immédiatement en cas d’anomalie.

Logique métier et couches mal découpées

Dans un prototype, il est tentant de regrouper la validation des données, les règles métier et l’interface en un seul bloc de code. Cette absence de séparation des responsabilités rend la maintenance complexe et le refactoring risqué.

Une logique métier mélangée à des appels directs à la base de données ou à des routines d’affichage empêche la réutilisation de modules et complique la montée en charge. Chaque demande d’évolution devient un chantier lourd, générant des dépendances cachées et des bugs imprévisibles.

Pour corriger, il faut identifier et extraire les composants métier dans des services indépendants, définir des interfaces claires et appliquer le principe de responsabilité unique. Cela facilite également l’écriture de mocks pour les tests et le déploiement de services dans des conteneurs modulaires.

Documentation et décisions non versionnées

Au stade du MVP, documenter chaque décision architecturale peut sembler superflu. À terme, l’absence de rationale (justification) rend incompréhensibles les choix technologiques, surtout pour les nouveaux arrivants.

Sans versionning des décisions — pourquoi tel framework, ce pattern, cet hébergement — il est impossible de retracer l’origine d’un défaut ou d’une dette. Les équipes passent alors un temps considérable à redécouvrir l’historique et à deviner les orientations à suivre.

La mise en place d’un registre d’architecture ou d’un repository de décisions (ADR) permet d’associer chaque choix à un ticket, une date et un contexte. Cela limite les incompréhensions et accélère l’onboarding.

Livrer à l’aveugle freine la scalabilité

Un pipeline de déploiement immature rime souvent avec incidents et retards. Sans CI/CD, monitoring et Infrastructure as Code, la production devient un terrain miné. Pour sécuriser votre rythme, discipline et visibilité sont indispensables.

Mise en place d’un CI/CD robuste

Sans intégration continue, chaque branche se situe dans un silo isolé, sans garantie qu’elle s’intègre au tronc principal. Les conflits de merge s’accumulent et génèrent des régressions tardives.

Un pipeline CI/CD mis en place dès la phase de prototype valide automatiquement la compilation, les tests unitaires et d’intégration, puis prépare un artefact versionné. Chaque merge sur la branche principale produit un build prêt à être déployé en staging.

Ce travail permet de raccourcir considérablement les délais entre l’écriture d’une ligne de code et sa mise à disposition aux équipes de QA, garantissant une montée en compétence rapide et une visibilité constante sur l’état du projet.

Infrastructure as Code pour la reproductibilité

Lorsque les environnements sont configurés manuellement, chaque différence entre développement, staging et production est une source de bugs aléatoires. Les tickets s’envolent à tester la configuration plutôt que le code.

En définissant vos environnements avec des scripts Terraform ou Ansible, vous obtenez une infrastructure versionnée et reproductible à l’identique. Les accidents dus à un paramètre oublié disparaissent, et l’onboarding d’un nouvel ingénieur prend quelques minutes.

De plus, Infrastructure as Code facilite la scalabilité : il suffit d’ajouter un nœud dans la configuration pour suivre l’augmentation de charge sans intervention manuelle ni documentation séparée.

Monitoring et observabilité complètes

Sans monitoring temps réel, on réagit toujours après coup. Les incidents surviennent en production, pénalisent l’expérience utilisateur et exigent des interventions d’urgence.

Un système d’observabilité alliant métriques, traces et logs structurés permet de détecter les anomalies avant qu’elles ne deviennent critiques. Les alertes automatisées informent l’équipe avant que les KPI ne dépassent les seuils tolérables.

Cette discipline transforme la confiance dans la plateforme : les équipes métiers et techniques suivent l’état du service via un dashboard unifié, ce qui libère du temps pour l’innovation.

Cas d’usage d’une start-up en santé digitale

Une start-up en santé digitale lançait des releases manuelles sans pipeline automatisé. Résultat : deux déploiements par mois, chacun provoquant des arrêts de service d’une heure et nécessitant des vérifications manuelles post-mise en production.

En migrant vers un pipeline GitLab CI/CD avec tests et déploiement blue-green, elle a triplé sa fréquence de releases et réduit son MTTR de 75 %. Ce cas démontre que la discipline de livraison accroît à la fois la cadence et la fiabilité.

Edana : partenaire digital stratégique en Suisse

Nous accompagnons les entreprises et les organisations dans leur transformation digitale

Intégrer la conformité avant l’industrialisation

La sécurité et la traçabilité ne sont pas des bonus à ajouter en fin de cycle. Laisser la conformité à l’arrière-plan expose à des refontes massives et à l’immobilisme commercial. De même, scaler sans structure amplifie vos faiblesses et fait exploser la complexité.

Gouvernance et contrôle d’accès dès l’architecture

Dans un environnement B2B ou fintech, l’absence d’un modèle de gouvernance adapté peut bloquer la mise sur le marché. Les audits de sécurité exigent une traçabilité et un contrôle fin des accès dès les premières lignes de code, renforcées par une sensibilisation cybersécurité.

Intégrer la journalisation des événements, les rôles et permissions dans le CI/CD garantit une conformité continue. Les revues de logs et les tests d’intrusion automatisés font partie du cycle, et non d’une checklist finale.

Cette rigueur transforme la conformité en avantage : la sécurité devient un argument commercial et la traçabilité un gage de confiance pour les partenaires et les clients.

Architecture API stable et gestion des versions

Une API sans contrat clair entre versions crée des cas d’usage instables. Les intégrations partners cassent dès qu’un champ est modifié, générant des tickets d’urgence et des patchs ad hoc.

En définissant des contrats versionnés (par exemple via OpenAPI) et en gérant les dépréciations par cycles planifiés, vous limitez les interruptions et facilitez l’adaptation des consommateurs d’API.

Une architecture claire permet aussi de scaler chaque service indépendamment, sans craindre qu’un déploiement ne casse tout l’écosystème.

Modularisation et résilience des pipelines de données

Les environnements IA ou Machine Learning amplifient la fragilité des pipelines de données. Un simple schéma modifié dans une source peut provoquer l’arrêt complet du traitement en aval.

En segmentant les étapes (extraction, transformation, chargement) en micro-services et en appliquant des patterns de retry et de circuit breaker, on automatise la résilience. Les incidents sont isolés et traités de façon incrémentale.

Ce découpage garantit une scalabilité maîtrisée : chaque module peut être dupliqué pour absorber la charge sans générer de dépendances cachées.

Cas d’usage d’un acteur helvétique du e-commerce

Une entreprise en ligne de taille moyenne a vu ses volumes de commandes doubler en un an. Son monolithe ne suivait plus, les incidents de traitement des stocks devenaient quotidiens et engendraient des ruptures de service.

Après avoir découpé le monolithe en services API indépendants (gestion des stocks, paiements, notifications), elle a réussi à scaler chaque composant selon son usage réel. La fiabilité est remontée de 99,2 % à 99,9 % et la maintenance s’est stabilisée.

Synchroniser autour d’une vision et d’un cadre clair

Des équipes désynchronisées patchent, improvisent et subissent. Résultat : maintenance épuise et l’innovation stagne. Pour un produit scalable, il faut aligner workflows, feedback et responsabilités.

Structures partagées et workflows prédictibles

Lorsque chaque équipe suit son propre process, les dépendances entre développement, QA et opérations ne sont pas maîtrisées. Les priorités divergent et les goulots d’étranglement apparaissent au hasard.

En définissant un backlog commun, des user stories claires et des rites agiles partagés, on crée un cadre où chaque acteur sait quand et comment intervenir. Les points d’intégration sont planifiés et validés collectivement.

Cette friction maîtrisée accélère la prise de décision et limite les rebonds inutiles entre les pôles.

Boucle de feedback transverse et indicateurs partagés

Sans visibilité sur les métriques clés (MTTR, couverture de tests, fréquence de releases), chaque équipe avance à l’aveugle. Les arbitrages se font sur des impressions plutôt que sur des données.

Mettre en place des dashboards partagés, des revues régulières et des objectifs communs aligne les priorités. La boucle de feedback — code, mise en production, retours utilisateur, ajustements — devient un moteur d’amélioration continue.

Les décisions se basent alors sur des faits, et non sur des opinions isolées.

Refactoring progressif et limites d’un full rewrite

Face à un MVP fragile, la tentation d’une réécriture totale peut sembler séduisante, mais elle bloque souvent les évolutions pendant des mois. La perte de repères et la dette nocturne s’accumulent alors.

Une approche incrémentale consiste à identifier les composants critiques, à les isoler et à les refactorer un à un. Les gains rapides sur les zones sensibles financent et motivent la suite du chantier.

Vous conservez ainsi un produit opérationnel tout en améliorant sa robustesse étape par étape.

Cas d’usage d’une institution de formation genevoise

Une institution de formation genevoise exploitait un MVP monolithique utilisé par plusieurs départements. Chaque équipe appliquait ses propres correctifs sans coordination, générant des conflits et des pertes de données.

Après avoir institué un comité d’architecture et défini des guidelines communes, elle a mis en place des branches Git protégées, des pipelines CI et un espace de documentation transverse.

La synchronisation a réduit de 60 % le temps passé en maintenance et permis d’ajouter de nouvelles fonctionnalités sans interruption de service.

Transformez votre MVP fragile en produit robuste

Passer du “vibe coding” à un produit scalable exige de structurer son code, d’automatiser tests et déploiements, d’intégrer la conformité en continu et de synchroniser ses équipes autour d’indicateurs partagés. Une architecture modulaire, un pipeline mature et une gouvernance claire sont les garants d’une vitesse durable.

Nos experts adaptent chaque démarche à votre contexte, mêlant open source, solutions évolutives et développement sur-mesure, pour transformer efficacement votre prototype en une plateforme fiable, performante et prête à croître.

Lectures: 73

Lectures: 73