Résumé – Monolithes legacy alourdissent la maintenance, freinent l’innovation, rallongent les cycles et exposent aux risques de sécurité et de non-conformité. Le refactoring continu outillé offre cartographie des dépendances, détection proactive des dérives, priorisation chiffrée et automatisation des transformations pour découpler en microservices, optimiser l’agilité et réduire coûts cloud. Solution : intégrer un outil open source de refactoring dans votre pipeline CI/CD pour moderniser progressivement sans perdre le contrôle.

Dans un contexte où les applications legacy freinent l’innovation, moderniser devient un impératif stratégique pour assurer agilité et pérennité. Ces monolithes vieillissants accroissent les coûts de maintenance, complexifient les évolutions et exposent aux risques de sécurité ou de non-conformité. Pourtant, aborder la modernisation sans outils de refactoring adaptés se traduit souvent par des initiatives longues, coûteuses et semées d’erreurs.

La discipline du refactoring continu, soutenue par des solutions spécialisées, offre une approche progressive qui garantit la continuité fonctionnelle, maîtrise les dérives architecturales et ménage les ressources. Selon une étude, 83 % des DSI jugent critique d’intégrer ces outils pour réduire les risques. Découvrons comment ils deviennent des leviers de réduction de la dette technique, d’accélération de l’évolutivité et de maîtrise des coûts cloud, tout en valorisant l’expérience développeur.

Les limites du refactoring manuel

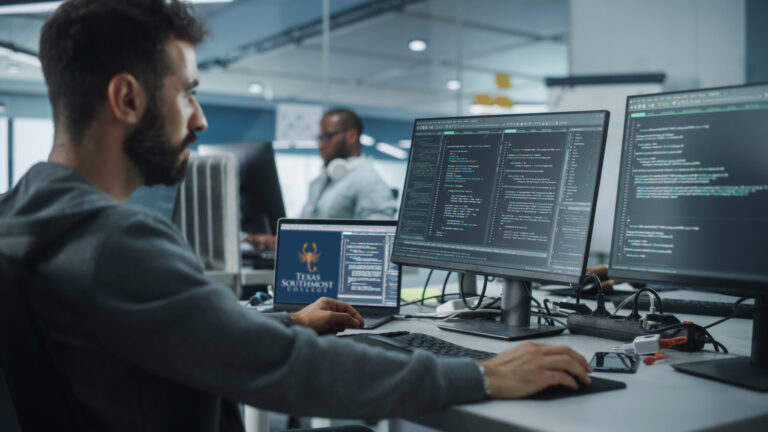

Le refactoring sans outils spécialisés repose sur des processus lents et sujets aux erreurs. Il mobilise des compétences rares et génère de la dette non documentée.

Complexité et erreurs dans les interventions

En l’absence d’outils, chaque modification de code implique une analyse manuelle des impacts, souvent réalisée à partir de code spaghettis mal documentés. Les risques de régression augmentent, et les tests unitaires ne suffisent pas toujours à couvrir l’ensemble des cas d’usage. Les vérifications deviennent laborieuses, ce qui conduit à privilégier la rapidité d’exécution au détriment de la qualité.

Les experts sollicités consacrent une part disproportionnée de leur temps à comprendre l’existant, au lieu de développer de nouvelles fonctionnalités. Chaque intervention nécessite une phase de relecture approfondie, qui alourdit la feuille de route. Les tâches peuvent être repoussées, faute de visibilité sur l’impact réel des modifications prévues.

Cette complexité se traduit par une augmentation de la durée des cycles de livraison et par une saturation des équipes IT. Sans outils adaptés, les risques de dérives et d’incidents de production restent élevés.

Cartographie et dépendances invisibles

Le refactoring manuel ne dispose pas de mécanismes automatiques pour modéliser les domaines fonctionnels et leurs interactions. Les relations entre modules restent implicites, figées dans des fichiers dispersés et non exploités. Les dépendances transverses, parfois réparties sur différents dépôts, échappent à toute mesure centralisée.

Sans visualisation, il est difficile de prioriser les zones à nettoyer ou à découper. Des boucles de rétroaction sont souvent nécessaires pour corriger des oublis, ce qui allonge les délais et génère des surcoûts.

Une entreprise industrielle a tenté de refactorer manuellement un module central sans cartographier ses dépendances. L’intervention a exigé trois cycles de relecture et d’ajustements, mobilisant deux architectes pendant six semaines. Cet exemple démontre combien l’absence de visualisation conduit à multiplier les itérations et les coûts.

Réduction de la dette architecturale

Un outil de refactoring expose la dette latente et simplifie sa gestion. Il permet de mesurer, prioriser et corriger les dérives structurelles en continu.

Visualisation et gouvernance des domaines

Les plateformes spécialisées offrent des cartes interactives des composants et de leurs interactions. Elles restituent la structure métier sous forme de graphes, facilitant la compréhension des zones critiques. Les décideurs et architectes disposent alors d’un référentiel unique qui alimente la gouvernance et oriente les choix stratégiques.

Cette visibilité rend possible le suivi des évolutions au fil du temps. Les équipes peuvent comparer les états avant et après chaque refactoring, mesurant ainsi l’impact des actions menées. La gouvernance architecturale s’en trouve renforcée et les processus d’approbation sont accélérés.

Détection proactive des dérives

Les outils de refactoring incluent souvent des règles de qualité architecturale, paramétrables selon les normes internes ou les meilleures pratiques du marché. Ils détectent automatiquement les violations, telles que les couplages excessifs ou les couches métiers détournées. Les alertes guident les équipes vers les zones nécessitant une intervention.

La détection proactive évite l’accumulation de dette non identifiée. Chaque anomalie renvoie à un ticket précis, documentant l’écart et proposant une stratégie de correction. Ce mode de fonctionnement préventif limite les coûts ultérieurs et facilite la réversibilité des décisions.

Un acteur bancaire ayant étendu son parc applicatif à une trentaine de modules a mis en place un audit automatisé des dépendances. L’outil a révélé une zone de code obsolète responsable de 20 % des incidents. La correction pilotée a réduit de moitié les régressions en production.

Priorisation et plan d’action ciblé

Les tableaux de bord de dette architecturale quantifient les écarts par composant, associant un score d’importance métier à chaque élément. Les architectes peuvent ainsi hiérarchiser les refactorings selon l’impact sur la scalabilité, la sécurité ou la conformité.

Un plan d’action basé sur des données chiffrées réduit les discussions interminables sur le périmètre des travaux. Les parties prenantes disposent d’indicateurs objectifs pour valider les arbitrages et suivre les progrès. La feuille de route devient plus précise et moins sujette aux retards.

Edana : partenaire digital stratégique en Suisse

Nous accompagnons les entreprises et les organisations dans leur transformation digitale

Amélioration de l’évolutivité et de l’agilité métier

Le refactoring structuré facilite la montée en charge et l’agilité métier. Il découple les composants pour absorber les pics sans refonte.

Passage progressif aux microservices

Les outils guident la décomposition du monolithe en services indépendants, en s’appuyant sur la même cartographie de dépendances. Les modules critiques – authentification, catalogue, workflow – sont isolés selon leur domaine métier et déployés séparément. Cette granularité assure une meilleure résilience et une évolutivité granulaire.

Une solution pilotée par un outil permet de générer automatiquement des interfaces REST ou des événements asynchrones entre services. Les développeurs conservent la cohérence du modèle de données sans dupliquer la logique métier. Chaque service peut évoluer à son rythme, selon la demande ou les spécifications techniques.

Un organisme de santé a segmenté son applicatif en domaines distincts pour le dossier patient, la facturation et la planification. Le refactoring outillé a permis d’obtenir des validations de sécurité plus rapides et une montée en charge contrôlée pendant la crise sanitaire.

Modularité et indépendance des déploiements

La modularité garantie par un refactoring outillé permet de déployer chaque élément de façon isolée, sans impacter l’ensemble du système. Les pipelines CI/CD sont alimentés automatiquement avec les artefacts correspondants à chaque service. Les versions sont tracées et les rollback facilitent la réversibilité.

En pratique, les cycles de livraison passent de plusieurs semaines à quelques jours. Les équipes métiers peuvent tester plus rapidement les nouvelles fonctionnalités, réduisant le time-to-market et améliorant la satisfaction des utilisateurs finaux.

Séparation claire des responsabilités

Un outil permet d’appliquer systématiquement le principe de responsabilité unique (Single Responsibility Principle) en isolant les fonctions métier. Chaque module ne gère plus que son domaine de compétences, et les tests ciblent précisément cette surface de code. La maintenance et l’extension deviennent plus sûres.

Cette séparation réduit la surface d’attaque pour la sécurité et facilite la conformité aux règles de gouvernance des données et des accès. Les équipes peuvent auditer chaque service indépendamment, accélérant les revues et les certifications internes.

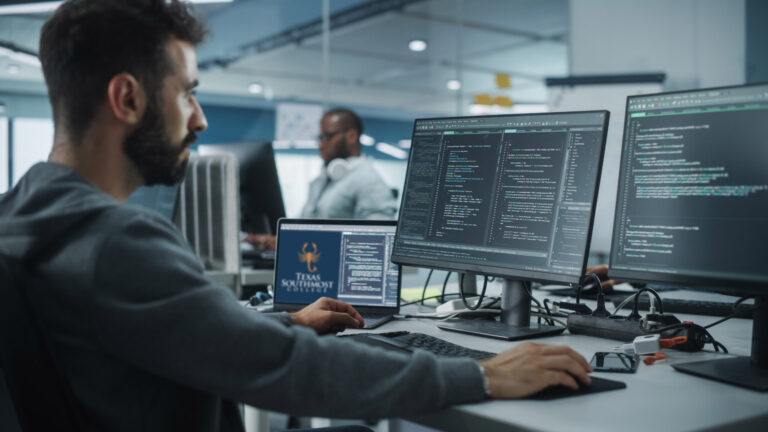

Réduction des coûts cloud et optimisation de la productivité développeur

Les outils de refactoring détectent et réduisent les inefficacités, ce qui diminue la consommation de ressources et les factures cloud. Ils automatisent les tâches répétitives pour libérer les développeurs.

Optimisation des frontières applicatives

Un outil identifie les zones à forte consommation de ressources, telles que les appels synchrones ou les boucles intensives. Il propose un découpage qui aligne la structure du code sur la topologie du cloud. Les services sont déployés sur des instances adaptées, évitant le surdimensionnement.

En affinant la granularité des modules, il devient possible de scaler horizontalement uniquement les composants les plus sollicités. Cette approche réduit de manière significative la facture cloud et limite l’empreinte carbone liée à l’infrastructure.

Automatisation des tâches de refactoring

Les outils intègrent des scripts de transformation de code et des générateurs d’API. Les développeurs n’ont plus à effectuer manuellement des refontes de signatures de méthode ou des ajustements de schémas de données. L’automatisation couvre également la création de tests unitaires et d’intégration pour chaque refactoring.

En supprimant les opérations manuelles répétitives, on réduit les risques d’erreur et l’effort de revue. Les équipes gagnent du temps sur les phases de préparation et peuvent se concentrer sur la conception de nouveaux services ou sur l’amélioration de l’expérience utilisateur.

Accélération du processus de modernisation

L’intégration du refactoring au pipeline CI/CD assure une discipline continue. Chaque pull request est analysée, repousse les anomalies et propose un plan d’action. Les itérations deviennent plus courtes et sécurisées, passant d’un mode “big bang” à une livraison progressive.

Les feedback loops se ferment plus rapidement, permettant de valider en production des changements incrémentaux. La gestion des risques est intégrée dès la phase de développement plutôt que reportée à la mise en production.

Transformez la modernisation en avantage compétitif

Les outils de refactoring constituent bien plus qu’un simple atout technique : ils offrent une approche holistique pour réduire la dette architecturale, renforcer l’évolutivité, optimiser les coûts cloud et libérer la créativité des équipes. En passant d’un traitement ponctuel à une discipline continue, vous garantissez la résilience et la flexibilité de votre écosystème logiciel.

Nos experts accompagnent chaque organisation dans le choix et la mise en place d’outils open source et modulaires adaptés à son contexte, pour éviter le vendor lock-in et faire de la modernisation un levier de croissance durable.

Lectures: 69

Lectures: 69